¿Qué es la indexación, para qué sirve y cómo indexar un sitio web en Google?

¿Alguna vez te has preguntado cómo los sitios web llegan a los resultados del motor de búsqueda y cómo logran los buscadores mostrarnos toneladas de información en tan solo unos segundos? La respuesta está en la indexación.

El secreto de este trabajo tan veloz está en el índice de búsqueda.

El índice de búsqueda o index se puede comparar como un directorio de archivos enorme y perfectamente ordenado de todas las páginas web. Esto significa que el motor de búsqueda vio, calificó y clasificó una web, para tenerla en cuenta (o no) cuando ofrezca los resultados de búsqueda.

Hoy, además, ese índice no solo alimenta los resultados tradicionales, sino también los sistemas de búsqueda impulsados por inteligencia artificial (como las AI Overviews), que utilizan la información indexada para generar respuestas directas en la SERP.

Es importante comprender el proceso y significado de indexar desde cero y entender cómo Google trabaja la indexación y gestiona el proceso.

¿Qué es la indexación y el rastreo de un sitio web?

Para entender la definición de este tema y poder comprender mejor el funcionamiento de la indexación de una web, es importante distinguir y profundizar en dos conceptos:

¿Qué es el rastreo?

El rastreo de páginas web es el proceso en el que un motor de búsqueda hace uso de programas especiales (también conocidos como robots de búsqueda, rastreadores o arañas) para recopilar datos de páginas nuevas y modificadas de diferentes sitios web.

En otras palabras, Google envía a sus robots a rastrear y almacena las URL recopiladas. A continuación, las clasifica y decide qué URL se indexan y cuáles no.

¿Qué es la Indexación?

La indexación de páginas de un sitio web vendría a ser escanear, leer y añadir datos al índice (directorio) gracias a la inestimable ayuda de los robots de búsqueda.

El motor de búsqueda utiliza la información recibida para conocer de qué trata una web y qué hay en sus páginas.

Después de eso, el buscador puede determinar las palabras clave para cada página escaneada y guardar copias de ellas en el índice de búsqueda. Para cada página, almacena una URL y la información sobre el contenido.

Sin embargo, indexar no significa necesariamente posicionar. Una página puede estar correctamente indexada y aun así no aparecer en los primeros resultados si Google considera que no responde mejor que otras a la intención de búsqueda.

Como resultado, cuando los usuarios realizan una consulta en Internet, el buscador escanea rápidamente su lista de sitios rastreados y muestra en los resultados de búsqueda solo las páginas que considera relevantes.

Es como un bibliotecario que busca los libros que necesita en el catálogo, alfabéticamente, por tema y por nombre exacto.

La indexación web en los diferentes motores de búsqueda tiene sus matices, pero veamos las principales características en el motor de búsqueda más conocido: Google.

¿Cómo lograr que las páginas se indexen?

Como veremos, puedes «forzar» la indexación o puedes dejar que suceda de forma natural. En cualquier caso has de tener en cuenta estos aspectos:

- Ten siempre presente las Core Web Vitals para que la experiencia de tus usuarios sea siempre satisfactoria.

- Trabaja el SEO On Page y el enlazado interno.

- Actualiza con frecuencia tus contenidos para que los bots no dejen de visitarte.

- Emplea el archivo robots.txt para bloquear páginas que no te interesa que se indexen.

- Evita las páginas huérfanas y el contenido duplicado.

- Evita cadenas de redirecciones y errores 4xx/5xx en páginas importantes.

¿Cómo saber si un sitio web está indexado en Google?

No todo el contenido indexado aparece en las SERP. De hecho, este es el principal caballo de batalla del SEO: aparecer en la primera página.

Entonces, ¿cómo podemos saber que un sitio web está indexado?

¿Cómo funciona la indexación en Google?

Cuando buscamos algo en Google, este no te ofrece información en tiempo real, sino que recurre a su index (o base de datos), donde se almacenan cientos de miles de millones de páginas.

Durante la búsqueda, se tienen en cuenta varios factores: tu ubicación, idioma, tipo de dispositivo, etc.

Además, Google aplica sistemas de clasificación y comprensión basados en inteligencia artificial que evalúan el contexto, la calidad y la utilidad del contenido antes de decidir qué mostrar y en qué formato.

En 2019, Google cambió su norma principal de indexar un sitio web al aparecer el mobile-first. La principal diferencia entre el nuevo método es que ahora el motor de búsqueda también almacena la versión móvil de las páginas en el índice.

Antes, la versión de escritorio era la que se tenía más en cuenta, pero ahora Google tiene dos tipos de rastreadores: el de ordenadores y el de dispositivos móviles.

Algunas características clave de la indexación web en Google

El index se actualiza constantemente.

- El proceso de indexación del sitio web puede tomar unos minutos o una semana.

En algunos casos, Google puede decidir no indexar determinadas páginas si detecta bajo valor añadido, contenido duplicado o problemas técnicos, incluso aunque hayan sido rastreadas correctamente.

A las páginas de baja calidad generalmente se les da un ranking bajo; sin embargo, no se eliminan del índice.

- No todas las páginas rastreadas se indexan. Google puede excluir del índice aquellas que considere poco útiles, duplicadas o de baja calidad. Solo las que aportan valor real y responden adecuadamente a la intención de búsqueda tienen más probabilidades de mostrarse en los resultados.

Ya sabemos qué hace el motor de búsqueda en tu sitio web, pero ¿cómo llega hasta ahí? Existen varias opciones.

¿Cómo los robots de búsqueda encuentran tu sitio web?

Si se trata de un nuevo contenido que no se ha indexado antes, debes «enviarlo» a los motores de búsqueda, y estos mandarán a sus rastreadores a tu web para recopilar datos.

También pueden encontrarte a través de enlaces externos que estén apuntando a tu web.

Lo recomendable es usar una de las siguientes opciones para “invitar” a Google:

- Crea un Sitemap, añade un enlace a robots.txt y envía el Sitemap a Google.

- Envía una solicitud para indexar la página modificada a Google Search Console.

Todo especialista en SEO quiere que su sitio se indexe más rápido, alcanzando tantas páginas como sea posible. Pero nadie puede influir en esto, ni aunque tu mejor amigo trabajara en Google.

La velocidad de rastreo e indexación depende de muchos factores, incluido el número de páginas en el sitio web, la velocidad del sitio, la configuración en webmaster y el presupuesto de rastreo.

En pocas palabras, el presupuesto de rastreo (Crawl budget) es el tiempo que pasa un rastreador en tu web, inspeccionando las URL y su contenido.

Y entonces, ¿hay alguna forma de influir en el proceso de indexación?

Poniéndoselo fácil a los rastreadores.

¿Cómo gestionar la visita de un robot de Google?

El motor de búsqueda descarga la información del sitio web, teniendo en cuenta el archivo robots.txt y el sitemap. Y es allí donde puedes recomendar al motor de búsqueda qué y cómo descargar o no descargar de tu página.

Archivo Robots.txt

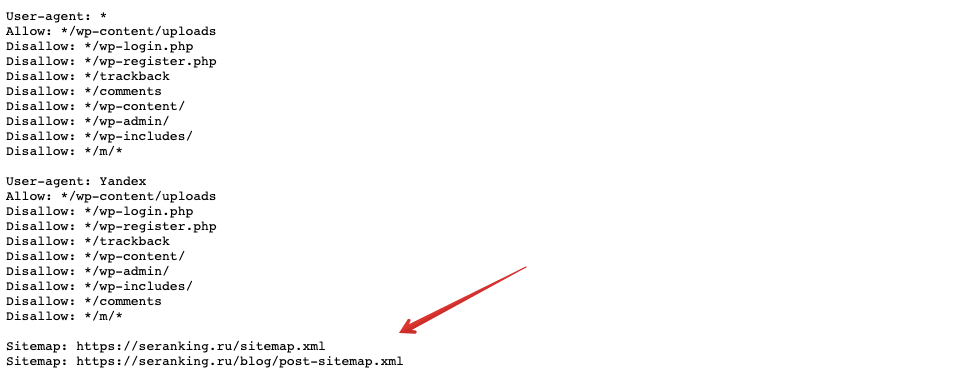

Este es un archivo de texto normal que contiene información básica, por ejemplo, a qué robots de búsqueda nos referimos (User-agent) y qué prohibimos rastrear (Disallow).

Las instrucciones en robots.txt ayudan a los bots de búsqueda a orientarse y no desperdiciar sus recursos rastreando páginas sin importancia (por ejemplo, archivos del sistema, páginas de autorización, contenido del carrito de compra, etc.).

Es importante recordar que bloquear una URL en robots.txt impide su rastreo, pero no garantiza su desindexación si existen enlaces externos que apunten a ella. Para evitar la indexación, es más eficaz utilizar la etiqueta noindex.

Por ejemplo, la línea Disallow:/admin evitará que los robots de búsqueda encuentren páginas cuya URL comience con la palabra admin, y la Disallow:/*.pdf$ bloqueará el acceso a los archivos PDF en el sitio.

Además, en el archivo robots.txt es necesario indicar la dirección del mapa del sitio para mostrar su ubicación a los robots de búsqueda.

Para verificar que el archivo robots.txt este correcto, usa las herramientas de Google Search Console o el comprobador de robots.txt de SE Ranking.

Archivo Sitemap

El mapa de sitio o sitemap te ayudará a optimizar el proceso de rastreo de tu web con robots de búsqueda.

En él se muestra cómo está organizado el contenido del sitio, qué páginas están sujetas a indexación y con qué frecuencia se actualiza la información que contienen.

Si hay pocas páginas en tu web, probablemente el motor de búsqueda las encontrará por sí mismo.

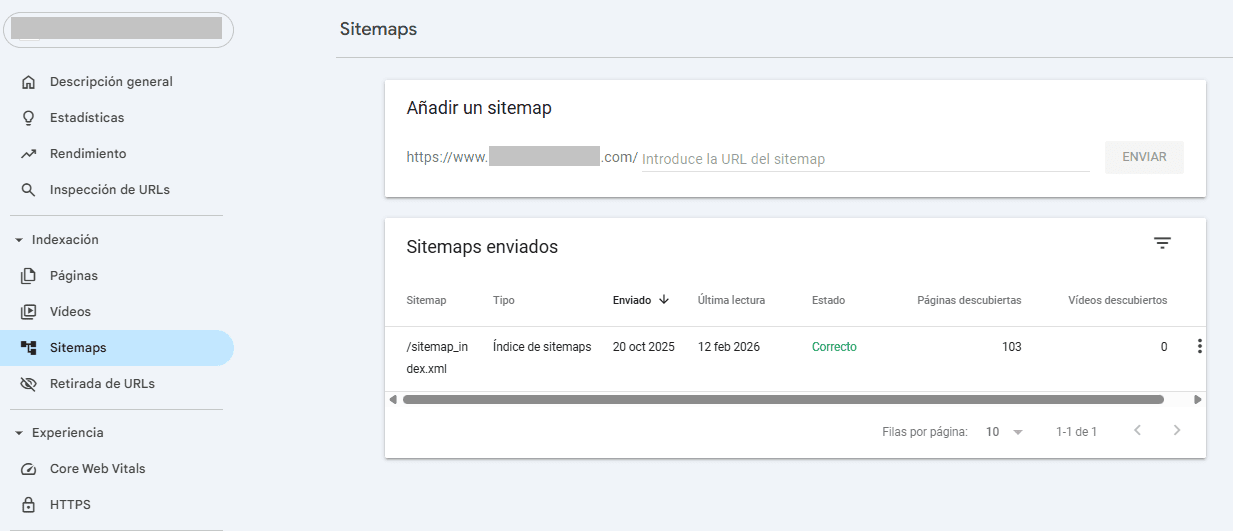

Aun así, enviar un sitemap actualizado a Google Search Console ayuda a acelerar el descubrimiento de nuevas URL y facilita el seguimiento del estado de indexación.

Pero cuando un sitio tiene millones de páginas, Google tiene que elegir cuáles rastrear y con qué frecuencia. Es por eso que el mapa del sitio ayuda a priorizar las páginas a rastrear, además de otros factores.

Además, para aquellas páginas webs en las que el contenido multimedia o noticias es muy importante, se puede mejorar el proceso de indexación al crear site maps separados por tipo de contenido:

- Mapas separados para vídeos que también pueden informar a los motores de búsqueda sobre la duración de la secuencia del vídeo, el tipo de archivo y las condiciones de la licencia.

- Mapas para imágenes, donde detalla lo que se está mostrando, el tipo de archivo, etc.

- Para noticias, la fecha de publicación, título del artículo y edición.

Para que el robot de búsqueda no pase por alto ni una sola página importante de tu sitio web, la navegación por el menú, las «migas de pan» y los interlinking entran en juego.

¿Qué otro tipo de información proporciona un sitemap?

En el mapa del sitio también se puede especificar:

- La frecuencia de actualización de una página específica, con la etiqueta <changefreq>;

- La versión canonical de la página – con el atributo rel=canonical;

- Las versiones de páginas en otros idiomas – con el atributo hreflang.

Un mapa del sitio también ayuda mucho a descubrir por qué existen dificultades al indexar tu web en Google.

Por ejemplo, si el sitio es muy grande, entonces se crean muchos mapas del sitio, separados por categoría o tipo de página.

Y luego, en la consola, es más fácil entender qué páginas no están indexadas para después modificarlas.

Puedes verificar la exactitud del archivo Sitemap en la Google Search Console de tu sitio web, en la «sección Sitemaps»

Una vez que tu sitio web ya ha sido enviado para la indexación, se ha comprobado el archivo robots.txt y el mapa del sitio, es hora de saber si tu página web se ha indexado o no.

También te puede interesar:

¿Cómo verificar la indexación del sitio web?

La verificación de la indexación del sitio se realiza de varias maneras:

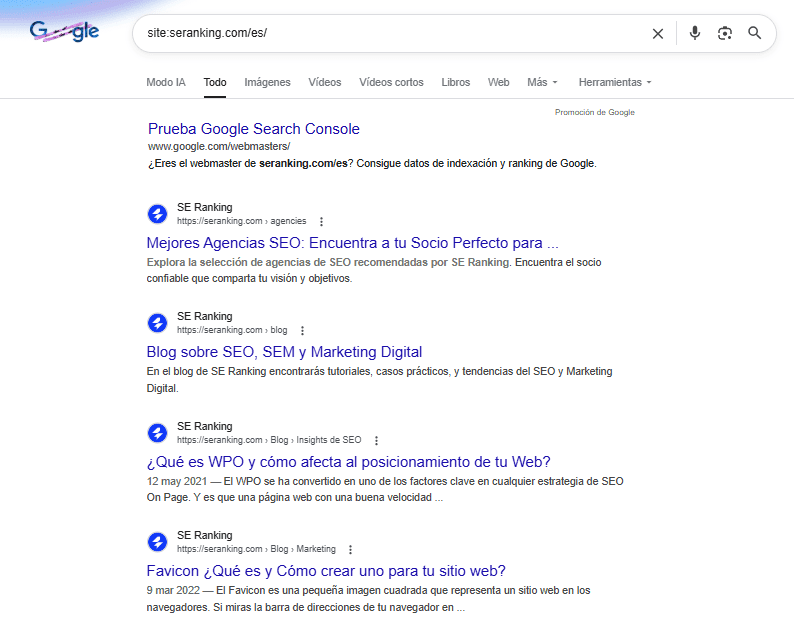

1. Utilizando el comando de búsqueda site:

En Google, este comando no proporciona una lista completa de páginas, pero nos dará una idea general de qué páginas están en el index.

También, proporciona resultados para el dominio principal y los subdominios.

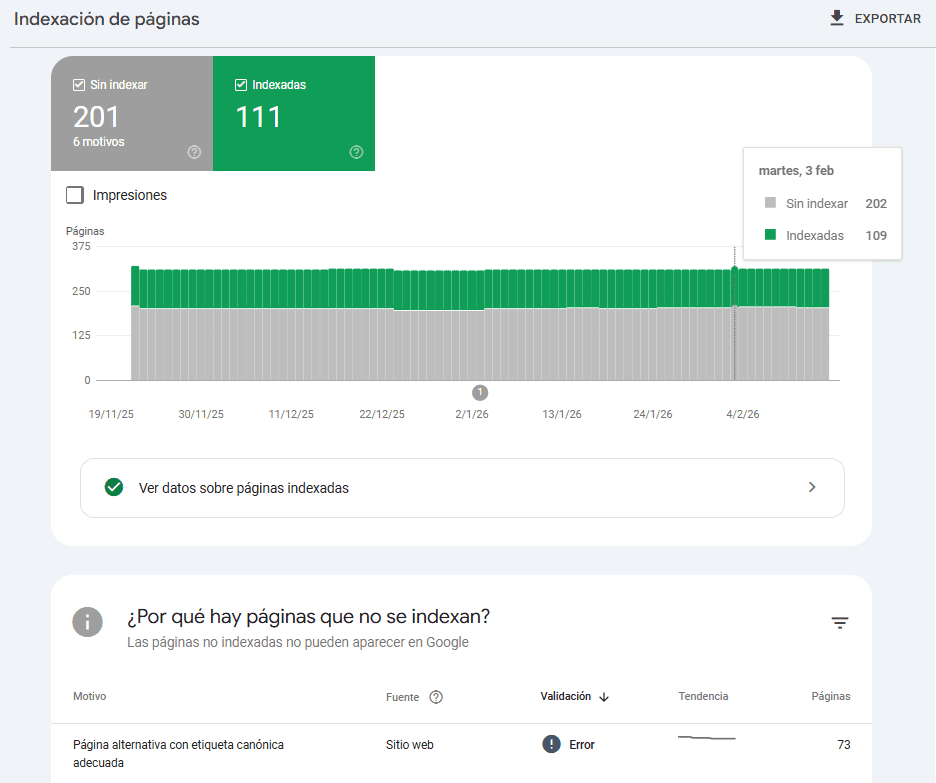

2. Usando Google Search Console

En Google Search Console encontrarás información detallada sobre todas las páginas: cuáles están indexadas, cuáles no y por qué.

La sección “Indexación > Páginas” permite conocer con precisión por qué una URL no está indexada, si ha sido rastreada pero excluida, o si presenta errores técnicos que impiden su inclusión en el índice.

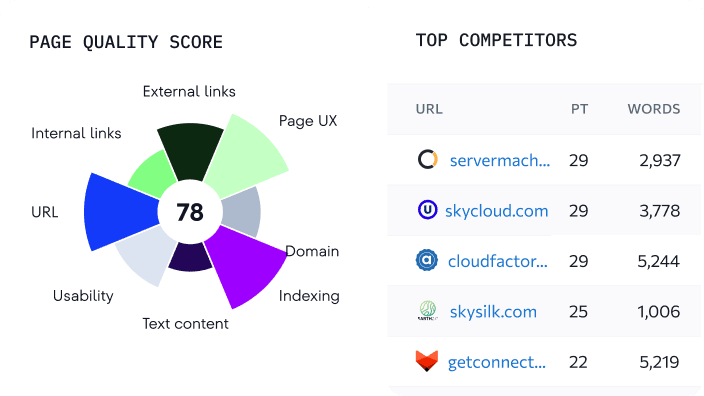

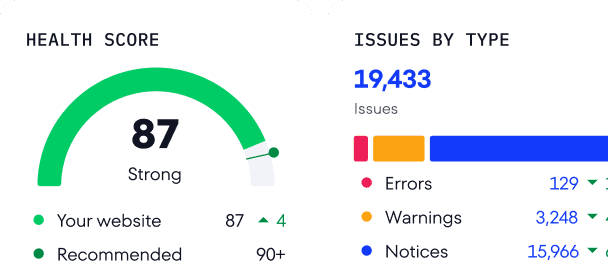

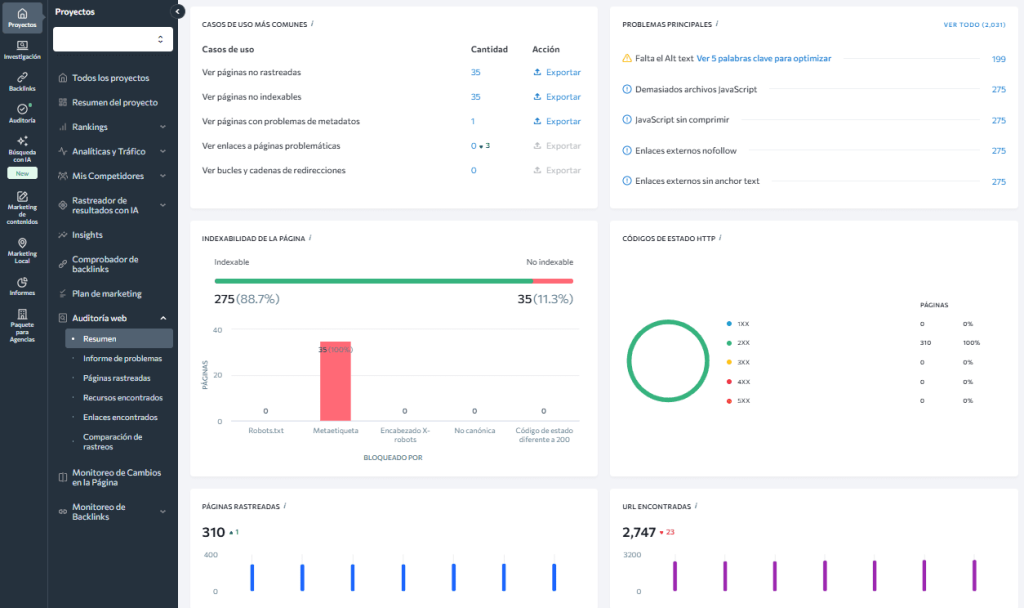

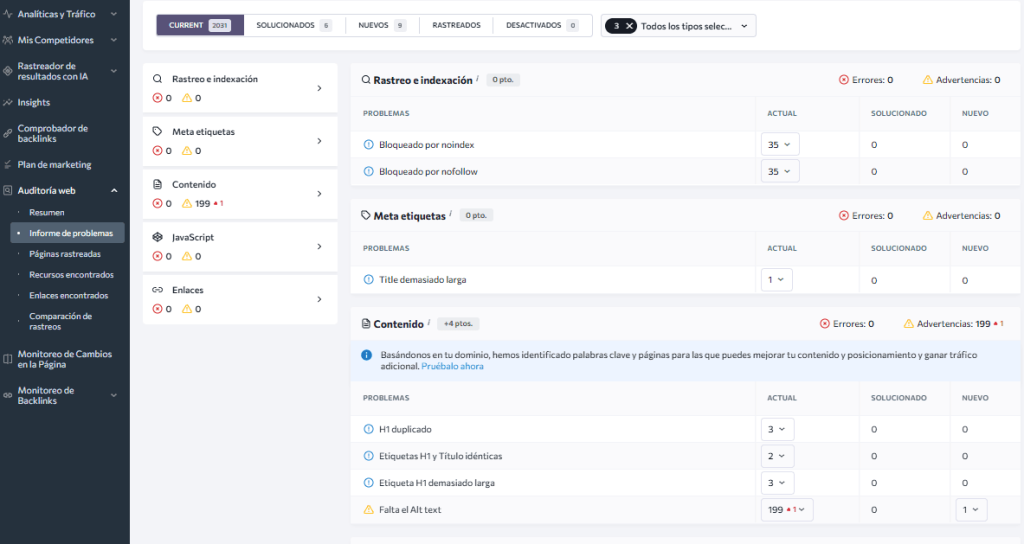

3. Con la auditoría web de SE Ranking

Con nuestra auditoría web tienes un diagnóstico completo de tu proyecto, incluida la indexación.

Ya una vez dentro, puedes ver el detalle en el Informe de problemas.

Ahora, puedes estarte preguntando: «¿Y qué pasa si tengo un sitio web en AJAX? ¿Entrará en el índice? Aquí tenemos la respuesta.

¿Cómo influyen las diferentes tecnologías de un sitio web en su indexación?

No todas las tecnologías se llevan bien con Google, por lo que si utilizas alguna de las siguientes, debes comprobar si cuentas con el favor del gran buscador.

Ajax y JavaScript moderno

Cada vez es más habitual encontrar sitios desarrollados con frameworks JavaScript que cargan contenido de forma dinámica y ofrecen una experiencia de usuario rápida e interactiva.

El problema no es JavaScript en sí, sino cómo se renderiza el contenido. Si parte de la información depende exclusivamente de la ejecución de scripts en el navegador (renderizado del lado del cliente), Google puede tardar más en procesarla o, en algunos casos, no interpretarla correctamente.

Hoy en día, Google es capaz de renderizar JavaScript y procesar aplicaciones dinámicas. Sin embargo, este proceso requiere más recursos y puede introducir retrasos entre el rastreo inicial y la indexación definitiva del contenido.

Por eso, es importante asegurarse de que:

- Las URL sean únicas y accesibles sin depender de acciones del usuario.

- El contenido principal esté disponible tras el renderizado.

- No existan bloqueos en el archivo robots.txt que impidan cargar archivos .js o .css necesarios para interpretar la página.

- Se utilicen buenas prácticas como renderizado del lado del servidor (SSR) o generación estática cuando sea posible.

Google puede indexar sitios basados en JavaScript, pero una implementación técnica deficiente puede afectar al rastreo, la comprensión del contenido y, en consecuencia, a su indexación.

Google cambia de opinión

Hace solo cinco años, los especialistas en SEO solo podían soñar con promocionar un sitio de este tipo en la búsqueda. Pero todo está cambiando.

Ahora, la información de referencia de Google contiene datos sobre lo que se necesita para indexar sitios AJAX y cómo evitar errores en este proceso.

Desde 2019, los sitios AJAX son procesados directamente por Google, esto significa que los robots de búsqueda rastrean y procesan #! URL, simulando el comportamiento humano.

No obstante, aunque Google puede renderizar JavaScript, los procesos de renderizado pueden requerir más tiempo y recursos. Por eso, una mala implementación técnica puede retrasar la indexación o afectar a la correcta comprensión del contenido.

Por lo tanto, los webmasters ya no necesitan reescribir la versión HTML de la página.

Aquí es importante verificar si las secuencias de comandos con estilos en tu archivo robots.txt están cerradas.

Si están cerradas, asegúrate de abrirlas para que los robots de búsqueda las puedan indexar. Para esto, añade los siguientes comandos a robots.txt:

User-agent: Googlebot Allow: /*.js Allow: /*.css Allow: /*.jpg Allow: /*.gif Allow: /*.png

Contenido Flash

Con la tecnología Flash, la cual pertenece a Adobe, en las páginas de un sitio web se puede crear contenido interactivo con animación y sonido.

Pero durante los 20 años de su desarrollo, esta tecnología ha revelado muchas deficiencias, incluida una gran carga al procesador, errores en el trabajo del reproductor flash y errores en la indexación del contenido por parte de los motores de búsqueda.

Google dejó de indexar contenido Flash y esta tecnología ya no está soportada por los navegadores modernos.

Por eso, no es una sorpresa que los motores de búsqueda sugieren no usar Flash en tus sitios web.

Si el diseño del sitio se realiza utilizando esta tecnología, también deberás hacer una versión de texto del sitio.

Será útil tanto para los usuarios que no tienen instalado Flash o tienen el programa de visualización desactualizado, como para los usuarios de dispositivos móviles (estos dispositivos no muestran contenido flash).

Frames

Un frame o marco es un documento HTML que no contiene su propio contenido, sino que consta de diferentes áreas, cada una con una página web separada. También le falta el elemento BODY.

Como resultado, los robots de búsqueda simplemente no tienen dónde buscar contenido útil para rastrear. Las páginas con marcos se indexan muy lentamente y con errores.

Google puede indexar contenido dentro del iframe incorporado. El iframe es compatible con las tecnologías modernas, ya que nos permite incrustar marcos en páginas sin usar la etiqueta <iframe>.

En cambio las etiquetas <frame>, <noframes>, <frameset> ya casi no se usan y no son compatibles con HTML5, por lo que, no se recomienda usarlas en los sitios web.

De hecho, incluso si las páginas con marcos están indexadas, tendrás dificultades para promocionarlas.

Conclusión

Los motores de búsqueda están listos para indexar todas las páginas de tu sitio web que sean necesarias.

Ten en cuenta que el índice de Google almacena cientos de miles de millones de páginas y crece cada día.

Pero que se cumpla con éxito muchas veces depende de ti.

Si entiendes los principios de indexación de los motores de búsqueda, no dañarás tu sitio con configuraciones incorrectas.

Si tienes en orden el archivo robots.txt y el mapa del sitio, vigilas los requisitos técnicos y te aseguras de que exista contenido útil y de calidad, los motores de búsqueda no pasarán por alto tu sitio web.

Recuerda que la indexación no se trata de si tu sitio será mostrado o no en una búsqueda.

En un entorno donde la búsqueda incorpora sistemas de inteligencia artificial, la indexación sigue siendo el primer paso imprescindible: sin estar en el índice, tu contenido no puede competir ni aparecer como referencia en ningún formato de resultado.

Es mucho más importante: cuántas y qué páginas aparecerán en el índice, qué contenido se rastreará en ellas y cómo se clasificará en la búsqueda.

¿Has comprobado la indexación de tu sitio web con nuestra herramienta SE Ranking?

Explícanos tu experiencia y la compartiremos con nuestra comunidad.