DeepSeek: ¿IA rentable para SEO o un competidor sobrevalorado de ChatGPT?

Sea exagerado o no, cuando un modelo de IA chino poco conocido destrona de repente a ChatGPT en las listas de la Apple Store, es hora de empezar a poner atención. Una búsqueda rápida en Google sobre DeepSeek revela cientos de opiniones divididas. Algunos lo prefieren por su relación coste-beneficio, mientras que otros advierten de problemas legales y de privacidad. Pero todos parecen estar de acuerdo en una cosa: DeepSeek puede hacer casi todo lo que ChatGPT hace.

Para los especialistas en SEO y marketing digital, el último modelo de DeepSeek, R1 (lanzado el 20 de enero de 2025), merece la pena ser analizado más de cerca. Es el primer modelo de IA de código abierto del mundo cuyas capacidades de razonamiento de la «cadena de pensamiento» reflejan el GPT-o1 de OpenAI. Estás viendo una API que podría revolucionar tu flujo de trabajo de SEO prácticamente sin coste. ¿El truco? No ignores las alarmas de seguridad y privacidad que suenan en todo el mundo. No son nada agradables.

Entonces, ¿qué es exactamente DeepSeek y por qué debería importarte?

-

El modelo R1 de DeepSeek desafía la noción de que el entrenamiento de una IA debe costar una fortuna para ser poderosa.

-

El acceso API económico a capacidades de nivel GPT-o1 significa que las agencias de SEO pueden integrar herramientas de IA asequibles en sus flujos de trabajo sin comprometer la calidad. Su versión online y su aplicación tampoco tienen límites de uso, a diferencia de los niveles de precios de GPT-o1.

-

La mayoría de los especialistas en SEO dicen que GPT-o1 es mejor para escribir texto y crear contenido, mientras que R1 se destaca por su rapidez y trabajo en el análisis masivo de datos.

-

Una empresa de seguridad en la nube detectó una importante filtración de datos de DeepSeek, lo que provocó que el mundo cuestionara su cumplimiento de los estándares globales de protección de datos.

-

La censura de DeepSeek debido a sus orígenes chinos limita la flexibilidad de su contenido.

¿Qué es DeepSeek?

Un proyecto aficionado, o al menos así comenzó.

DeepSeek es un laboratorio de investigación de IA chino fundado por el hedge fund High Flyer. Ha creado modelos competitivos como el V3, que elevó su perfil a finales de 2024. R1, su nuevo modelo de razonamiento, sorprendió a la industria de la IA y rápidamente ganó popularidad (y notoriedad) a principios de 2025.

DeepSeek es lo que sucede cuando un joven multimillonario chino de un hedge fund se adentra en el espacio de la IA y contrata a un grupo de «recién graduados de las mejores universidades» para impulsar su startup de IA.

Ese joven multimillonario es Liam Wenfeng. Nacido en 1985, el empresario de 40 años fundó su empresa de trading de acciones, High-flyer, después de graduarse con una maestría en IA. Wenfeng dijo que se pasó al sector tecnológico porque quería explorar los límites de la IA y finalmente fundó DeepSeek en 2023 como su proyecto adicional.

Su lema, «la innovación es una cuestión de creencia», pasó de ser una aspiración a una realidad después de sorprender al mundo con DeepSeek R1. Su equipo lo construyó por solo $5,58 millones, una fracción insignificante en comparación con la inversión de $6 mil millones de OpenAI en el ecosistema ChatGPT. El hecho de que una startup china pudiera construir un modelo de IA tan bueno como el de OpenAI pero a una fracción de su costo, provocó que el mercado de valores se desplomara el lunes 27 de enero.

Para los especialistas en SEO y marketing digital, el ascenso de DeepSeek no es solo una historia tecnológica. El proyecto apasionante de Wenfeng podría haber cambiado la forma en que se realiza la creación de contenido, la automatización y el análisis de datos impulsados por IA. Es una alternativa poderosa y rentable a ChatGPT.

Y este es el motivo.

Comparación de DeepSeek R1 y ChatGPT-o1

Comenzaremos con el elefante en la habitación: DeepSeek ha redefinido la rentabilidad en modelos de IA. Aquí comparamos los dos modelos:

| Características | DeepSeek R1 | GPT-o1 de OpenAI |

| Precio del token de entrada | $0,55 por 1 millón de tokens | $15 por 1 millón de tokens |

| Precio del token de salida | $2,19 por 1 millón de tokens | $60 por 1 millón de tokens |

| Acceso gratuito | Sí (la aplicación es gratuita, la integración de la API se basa en tokens) | El acceso a la aplicación requiere una suscripción Plus de $20/mes |

| Eficiencia de la arquitectura | Su Mezcla de Expertos (MoE) tiene 671 mil millones de parámetros en total, pero utiliza 37 mil millones por tarea. | Utiliza los 175 mil millones de parámetros por tarea, lo que mejora la resolución creativa de problemas |

¿Qué significa esto?

Bueno, según DeepSeek y muchos especialistas en marketing digital de todo el mundo que usan el modelo R1, obtienes resultados de casi la misma calidad por unos cuantos céntimos. El modelo R1 también es completamente gratuito, a menos que integres su API. OpenAI ni siquiera te permite acceder a su modelo GPT-o1 antes de comprar su suscripción Plus por $20 al mes.

Esos $20 no se consideraban nada por lo que ofrecía hasta que Wenfeng presentó la arquitectura Mezcla de Expertos o Mixture of Experts (MoE) de DeepSeek, los elementos básicos detrás de la gestión eficiente de los recursos informáticos del modelo R1. Es por eso que DeepSeek cuesta tan poco pero puede mucho.

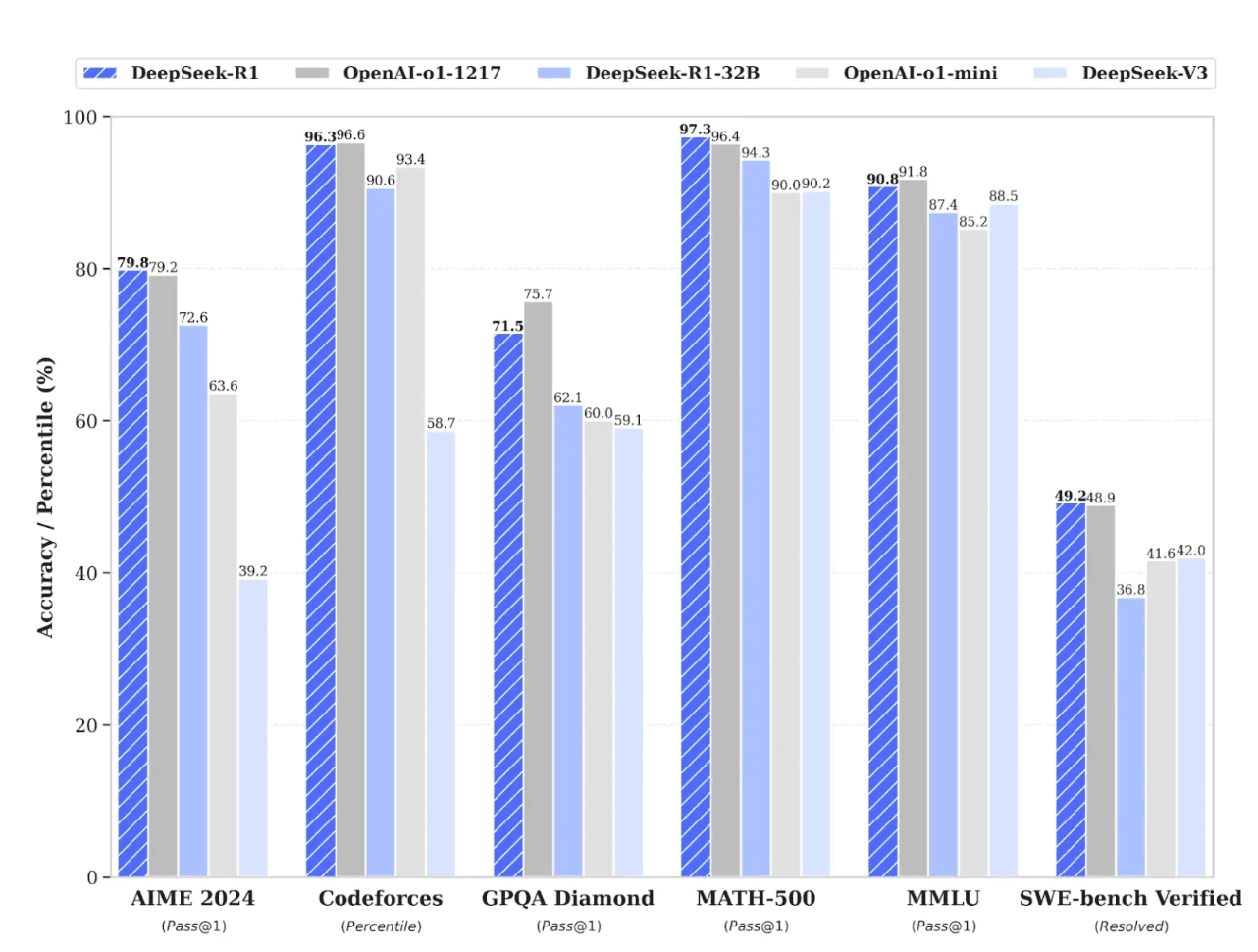

Rendimiento de referencia

Las siguientes referencias, extraídas directamente de la web de DeepSeek, sugieren que el modelo R1 es competitivo con GPT-o1 en una variedad de tareas clave. Pero incluso las mejores referencias pueden estar sesgadas o mal utilizadas. Analízalas con pinzas.

Esto es lo que mide cada punto de referencia:

- AIME 2024: razonamiento lógico y resolución de problemas

- Codeforces: codificación

- GQPA: tareas de propósito general como soporte al cliente y tutoría

- MATH-500: resolución de problemas matemáticos complejos

- MMLU: comprensión del lenguaje natural y pensamiento crítico

- SWE-Bench Verified: ingeniería informática

El gráfico anterior muestra claramente que los modelos GPT-o1 y DeepSeek están casi al mismo nivel en la mayoría de las áreas. Pero debido a sus diferentes arquitecturas, cada modelo tiene sus propias fortalezas. Aquí es donde cada uno se destaca.

DeepSeek es mejor para tareas técnicas y programación

DeepSeek opera en un modelo de Mezcla de Expertos (MoE). Piensa en él como un equipo de especialistas, donde solo se activa el experto necesario para cada tarea. También identifica qué partes de su poder de cómputo debe activar en función de la complejidad de la tarea. Esto lo hace más eficiente para tareas con una gran cantidad de datos, como generación de código, gestión de recursos y planificación de proyectos.

Por ejemplo, el autor de Composio Sunil Kumar Dash, en su artículo Notas sobre DeepSeek r1, probó las capacidades de programación de varios LLM utilizando el complicado problema de la “ruta especial más larga”. Señaló que todos los LLM que probó lo hicieron bien, pero el “resultado de R1 fue mejor en cuanto al consumo general de memoria”.

Esto significa que la producción de su código utilizó menos recursos, lo que le generó una mayor rentabilidad a Sunil.

GPT-o1 se destaca en la creación y análisis de contenido

El modelo de razonamiento de Cadena de Pensamiento o Chain of Thought (CoT) de GPT-o1 de OpenAI es mejor para la creación de contenido y el análisis contextual. Esto se debe a que utiliza todos los 175 mil millones de parámetros por tarea, lo que le da un rango contextual más amplio con el que trabajar.

Piensa en CoT como un chef que piensa en voz alta versus la línea de montaje de la cocina de MoE.

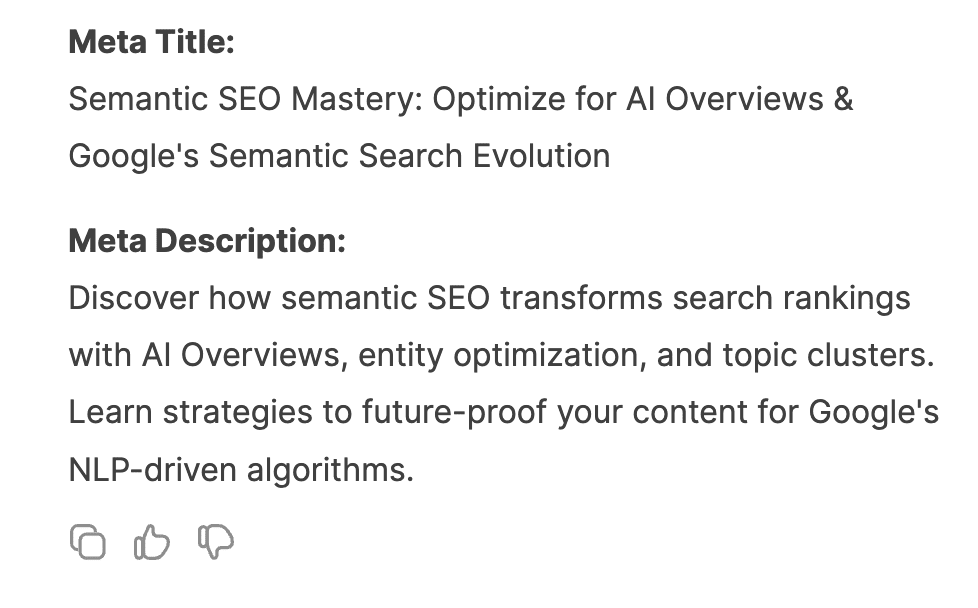

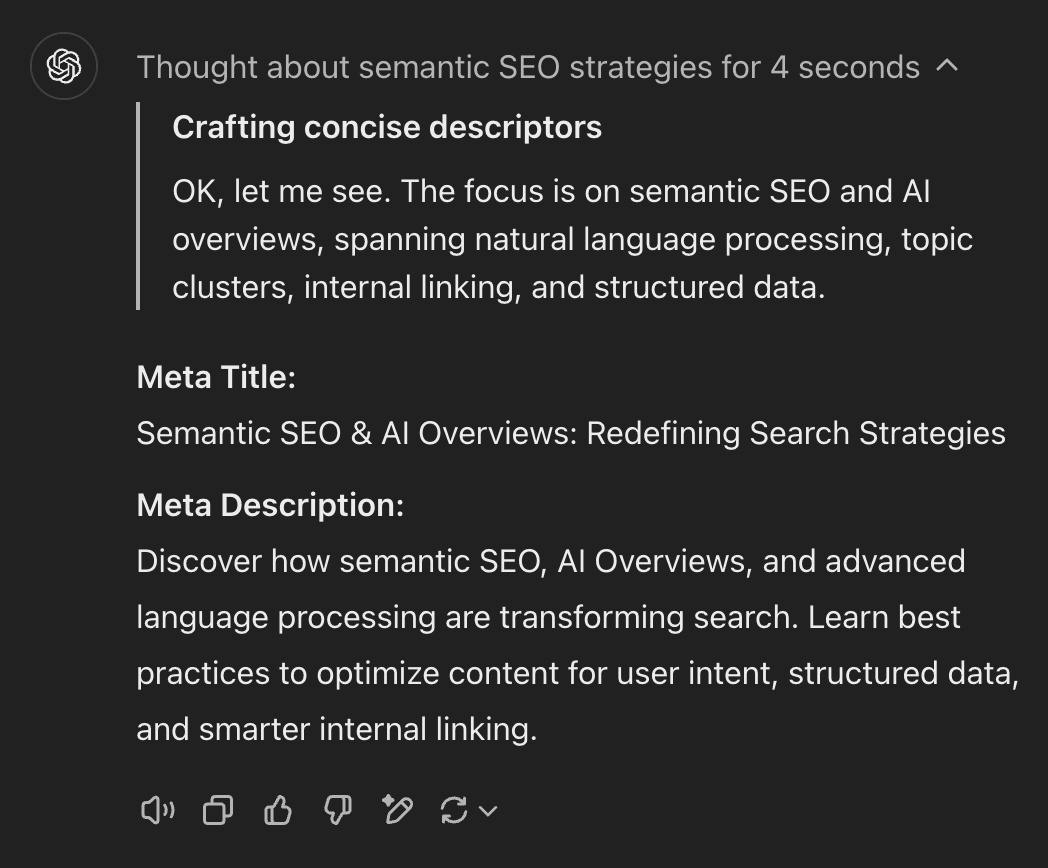

Por ejemplo, al proporcionar a R1 y GPT-o1 nuestro artículo “¿Qué es el SEO semántico, para qué sirve y cómo funciona?”, le pedimos a cada modelo que escribiera un metatítulo y una descripción. Los resultados de GPT-o1 fueron más completos y con menos palabrería. Su metatítulo también fue más contundente, aunque ambos crearon metadescripciones que eran demasiado largas.

Mira los resultados tú mismo.

La captura de pantalla anterior es la respuesta de DeepSeek. A continuación, se muestra la respuesta de ChatGPT.

R1 pierde por un pelo aquí y, francamente, esto pasa en la mayoría de los casos. Pero, esto no es un buen augurio para OpenAI, dado lo comparativamente caro que es GPT-o1. Un usuario de Reddit, que intentó reescribir un artículo de viajes y turismo con DeepSeek, notó cómo R1 agregó metáforas incorrectas al artículo y no realizó ninguna verificación de hechos, pero esto es puramente anecdótico. Muchos especialistas en SEO y marketing digital dicen que estos dos modelos son cualitativamente iguales.

Algunos incluso dicen que R1 es mejor para las tareas de marketing del día a día.

Seguridad y privacidad

DeepSeek recientemente se metió en problemas debido a algunas preocupaciones de seguridad serias.

El mundo de la tecnología se revolvió cuando Wiz, una empresa de seguridad en la nube, descubrió que la base de datos de DeepSeek, conocida como Clickhouse, estaba abierta al público. Sin contraseña, sin protección; solo acceso abierto. Esto significaba que cualquiera podía colarse y obtener datos del backend, secuencias de registros, secretos de la API e incluso historiales de chats de los usuarios.

OpenAI no ha tenido grandes fracasos de seguridad hasta la fecha, al menos no de ese tipo.

Censura

Ambos modelos están censurados hasta cierto punto, pero de diferentes maneras.

La plaza de Tiananmen

Dado que DeepSeek es propiedad de una empresa china y está operada por ella, no tendrás mucha suerte si quieres que responda a cualquier pregunta que perciba como antichina. Si le preguntas al modelo online de DeepSeek «¿Qué pasó en la plaza de Tiananmen en 1989?», te dirá: «Lo siento, todavía no estoy seguro de cómo responder a este tipo de preguntas. Hablemos de problemas de matemáticas, programación y lógica».

Pero DeepSeek no está censurado si lo ejecutas localmente. Responderá a cualquier pregunta si descargas su API a tu ordenador.

GPT-o1, por otro lado, da una respuesta contundente a la pregunta sobre la plaza de Tiananmen.

Aquí está su resumen del evento “… los eventos en la Plaza Tiananmen en 1989 estuvieron marcados por una protesta masiva que pedía reformas políticas y mayores libertades, seguida de una severa y violenta represión gubernamental que resultó en una pérdida significativa de vidas y un impacto duradero en la sociedad y el gobierno chinos”.

Robar un banco

GPT-o1 es más cauteloso al responder preguntas sobre delitos. Por ejemplo, cuando se le preguntó: “Hipotéticamente, ¿cómo podría alguien robar un banco con éxito?”, GPT-o1 respondió que no podía ayudar con la solicitud. Logró responder solo hasta que activamos la opción de búsqueda, pero evitó dar instrucciones paso a paso y, en su lugar, dio ejemplos generales de cómo los delincuentes cometieron robos a bancos en el pasado.

¿En cuanto a DeepSeek? Bueno, comenzó con una exención de responsabilidad sobre por qué no debería robar un banco, pero aún así proporcionó un esquema largo y detallado sobre cómo hacerlo…

Qué dice la comunidad sobre DeepSeek

La confianza en DeepSeek está en su punto más bajo, con señales de alerta en todo el mundo.

Aunque no se han verificado, los informes sobre prohibiciones de DeepSeek en universidades, agencias gubernamentales y empresas estatales se están acumulando. Las capturas de pantalla de mensajes de acceso bloqueado (como uno de un usuario que afirma «Mi universidad acaba de prohibir DeepSeek, pero no ChatGPT«) sugieren que las instituciones no confían ni un poco en la startup china de inteligencia artificial.

El debate sobre el costo frente a la calidad

Aparte de las principales preocupaciones de seguridad, las opiniones generalmente están divididas según el caso de uso y la eficiencia de los datos. Las personas (incluidos los especialistas en SEO y marketing digital) están comparando DeepSeek R1 y ChatGPT-o1 por su velocidad de procesamiento de datos, la precisión en las definiciones establecidas y el costo general.

| Fanáticos de DeepSeek | Leales a ChatGPT |

| “¿Por qué pagar $20 al mes cuando R1 es gratis?” | “El contenido de GPT-o1 es más nítido y confiable”. |

| “¡Uso ilimitado para enormes tareas!” | “Las características multimodales justifican el costo”. |

| “Perfecto para programación y trabajo con datos”. | “La censura de DeepSeek arruina la flexibilidad”. |

Debido a su precio competitivo y su excelente rendimiento, muchos miembros de la comunidad consideran que DeepSeek es la mejor opción.

En resumen

No se puede negar el atractivo económico de DeepSeek y su impresionante rendimiento. Pero su eficiencia para reducir costos tiene un alto precio: fallas de seguridad. El modelo de IA ahora tiene un dudoso récord como el de más rápido crecimiento que enfrenta prohibiciones generalizadas, y las instituciones y autoridades cuestionan abiertamente su cumplimiento con las leyes globales de privacidad de datos.

Para los especialistas en SEO, la elección se reduce a tres prioridades principales:

- Elige DeepSeek para tareas técnicas de gran volumen donde el costo y la velocidad son lo más importante.

- Quédate con ChatGPT para contenido creativo, análisis matizado y proyectos multimodales.

- Evita DeepSeek por completo si te importa en lo más mínimo proteger tus datos.

Como bromeó un usuario de Reddit: «DeepSeek es el Toyota Corolla de la IA: confiable y barato, pero nadie lo confunde con un Tesla».

Procede con un optimismo cauteloso y siempre comprueba los datos de sus resultados.