DeepSeek : une IA abordable pour les SEO ou un concurrent surestimé de ChatGPT ?

Quand un modèle d’IA chinois encore peu connu dépasse ChatGPT dans les classements de l’App Store, il devient impossible d’éviter ce phénomène. Pourtant, une recherche rapide sur DeepSeek révèle des avis contrastés. Certains utilisateurs apprécient son coût abordable, tandis que d’autres soulignent des risques liés à la confidentialité et aux questions légales. Une chose est sûre : DeepSeek est capable de faire tout ce que fait ChatGPT.

Pour les spécialistes SEO et les marketeurs, le dernier modèle de DeepSeek, R1 (lancé le 20 janvier 2025), mérite toute votre attention. En effet, c’est le premier modèle d’IA open-source capable d’un raisonnement en chaîne de pensée, identique au GPT-o1 d’OpenAI. Son API pourrait bien transformer votre flux de travail gratuitement. Mais n’oubliez pas que les alertes sur la sécurité et la confidentialité se multiplient à l’échelle mondiale, et c’est toujours embêtant.

Qu’est-ce que DeepSeek, et pourquoi il mérite votre attention ?

-

Le modèle R1 de DeepSeek remet en question l’idée qu’une IA doit être chère pour être une solution performante.

-

Un accès API abordable à des capacités similaires à celles de GPT-o1 permet aux agences SEO d’intégrer des outils d’IA à moindre coût, sans sacrifier la qualité. De plus, sa version en ligne et son application n’imposent aucune limite d’utilisation, contrairement à GPT-o1.

-

Selon de nombreux spécialistes SEO, le GPT-o1 est plus performant pour la rédaction et la création de contenu, tandis que R1 se distingue par sa rapidité et sa capacité à traiter de gros volumes de données.

-

Une entreprise de cybersécurité a récemment découvert une fuite de données majeure provenant de DeepSeek, ce qui pose des questions par rapport aux normes mondiales de protection des données.

-

Un autre point important, la censure imposée par ses origines chinoises limite la flexibilité de son contenu.

Qu’est-ce que DeepSeek ?

Un projet personnel… qui a bien évolué au fil du temps.

DeepSeek est un laboratoire chinois de recherche en IA, fondé par l’hedge fund High Flyer. Il s’est fait connaître grâce à des modèles performants comme V3, qui est devenu populaire fin 2024. Le modèle R1 a surpris l’industrie de l’IA avec sa puissance gagnant en popularité au début de 2025.

DeepSeek, c’est le résultat d’un milliardaire chinois de la finance qui décide d’explorer le domaine de l’IA et recrute une équipe de « jeunes talents issus des meilleures universités » pour lancer sa startup.

Ce jeune milliardaire, c’est Liam Wenfeng. Né en 1985, cet entrepreneur de 40 ans a fondé sa société de trading, High Flyer, après un master en IA. Il explique sa passion pour la tech par sa curiosité à repousser les limites de l’IA et, finalement, il crée DeepSeek en 2023, à l’origine comme un simple projet parallèle.

Sa devise, « L’innovation est une question de confiance » est devenue la réalité après le choc de DeepSeek R1. Son équipe a conçu ce modèle avec un budget de 5,58 millions de dollars — une somme ridicule face aux 6 milliards dépensés par Open AI dans l’écosystème de ChatGPT. Le fait que cette startup ait pu développer le modèle d’IA aussi performant pour un coût aussi bas a provoqué une chute des marchés boursiers le lundi 27 janvier.

Pour les spécialistes SEO et les marketeurs, la popularité de DeepSeek ne se limite pas à une simple avancée technologique. Le projet passion de Wenfeng a transformé la création de contenu, l’automatisation et l’analyse des données basées sur l’IA. DeepSeek est une alternative performante et abordable à ChatGPT.

Voici pourquoi.

DeepSeek R1 vs ChatGPT-o1

On commence par le sujet tabou : le prix. DeepSeek a redéfini la notion de rentabilité en IA. Voici la comparaison de deux modèles :

| Fonctionnalité | DeepSeek R1 | OpenAI’s GPT-o1 |

| Jetons d’entrée | 0,55 $ pour 1 million de tokens | 15 $ pour 1M de tokens |

| Jetons de sortie : | 2.19 $ pour 1M de tokens | 60 $ pour 1M de tokens |

| Accès gratuit | Oui (application gratuite, integration API facturée selon l’usage des tokens) | Nécessite un abonnement Plus à $20/mois |

| Efficacité Architecturale | Son modèle Mixture of Experts (MoE) comprend 671 milliards de paramètres au total, mais en utilise 37 milliards par tâche. | Utilise l’ensemble de ses 175 milliards de paramètres par tâche, améliorant ainsi la résolution créative des problèmes. |

Qu’est-ce que cela signifie ?

Eh bien, selon DeepSeek et de nombreux spécialistes du marketing digital qui utilisent le modèle R1, les résultats sont identiques à ceux de GPT-01. De plus, son utilisation est entièrement gratuite, sauf si vous intégrez son API. Chez OpenAI, impossible d’accéder au modèle GPT-01 sans au moins souscrire à l’abonnement Plus à 20 $ par mois.

Au début, ces 20 $ semblaient une somme ridicule pour la quantité de résultats que l’on pouvait obtenir. Mais avec l’introduction de MoE (Mixture of Experts) par Wenfeng et son modèle optimisé, beaucoup ont commencé à douter.

Performances de référence

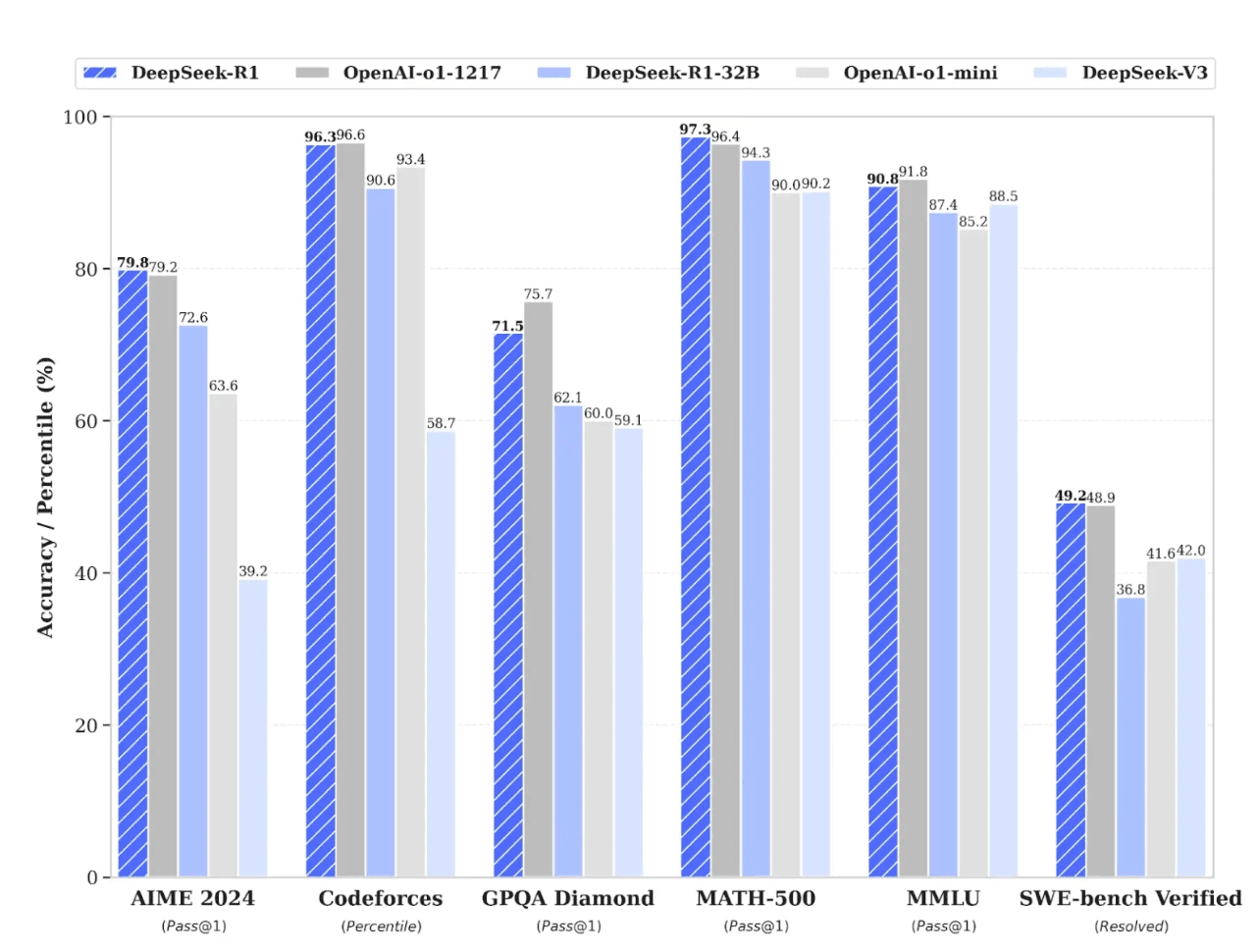

Les benchmarks ci-dessous, issus directement du site de DeepSeek, montrent que R1 obtient des résultats similaires à ceux de GPT-01 sur de nombreuses tâches clés. Cependant, même les meilleurs tests de performance peuvent être mal interprétés. Il est donc préférable de les considérer avec prudence.

Explication de chaque benchmark :

- AIME 2024 : Raisonnement logique et résolution de problèmes

- Codeforces : Programmation

- GQPA : Tâches générales comme le support client et le tutorat

- MATH-500 : Résolution de problèmes mathématiques complexes

- MMLU : Compréhension du langage naturel et esprit critique

- SWE-Bench Verified : Ingénierie logicielle

Le graphique ci-dessus montre clairement que GPT-01 et DeepSeek sont au coude-à-coude dans la plupart des domaines. Cependant, leurs architectures différentes se démarquent sur certains aspects. Voici leurs points forts respectifs.

DeepSeek est plus performant pour les tâches techniques et la programmation

DeepSeek repose sur une architecture Mixture of Experts (MoE). Imaginez une équipe de spécialistes où seul l’expert requis est activé pour chaque tâche. Il ajuste également l’utilisation correcte de sa puissance en fonction de la complexité d’une tâche. Cette approche est plus efficace pour les tâches difficiles comme la génération de code, la gestion des ressources et la planification de projets.

Par exemple, Sunil Kumar Dash, auteur chez Composio, a évalué les capacités de divers LLM en programmation dans son article Notes on DeepSeek R1, en utilisant le problème complexe du Longest Special Path. Il a indiqué que tous les modèles testés avaient fourni une réponse correcte, et que R1 s’était en plus démarqué par une meilleure gestion de la mémoire.

Cela signifie que son code a consommé moins de ressources tout en offrant d’excellents résultats.

GPT-01 excelle dans la création et l’analyse de contenu

Le modèle de raisonnement Chain of Thought (CoT) de GPT-o1 d’OpenAI est plus performant pour la création de contenu et l’analyse contextuelle. Comme il utilise l’ensemble de ses 175 milliards de paramètres à chaque tâche, il permet de traiter un contexte plus large.

C’est comme comparer un chef qui réfléchit à voix haute, tandis que MoE fonctionne comme une chaîne de production.

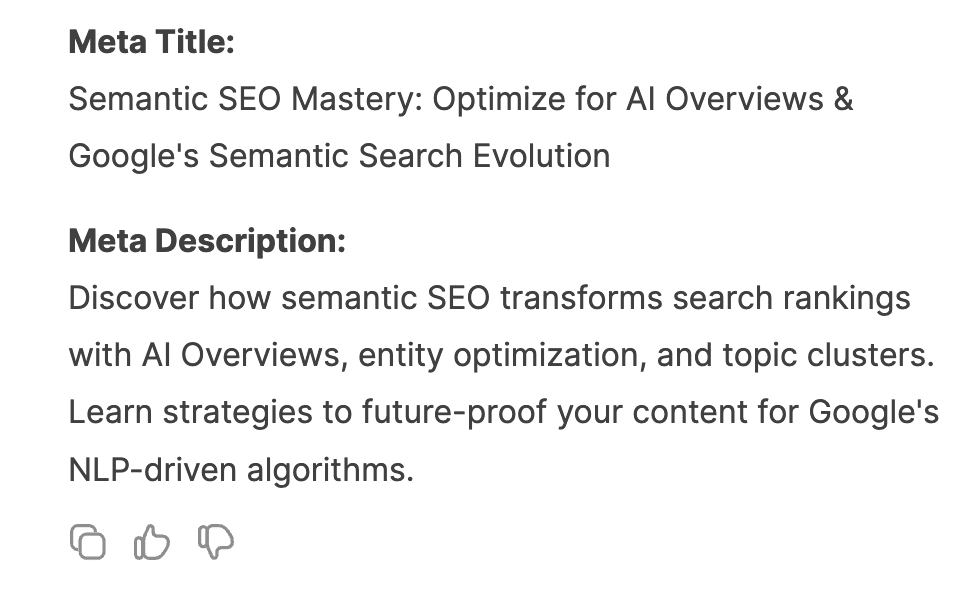

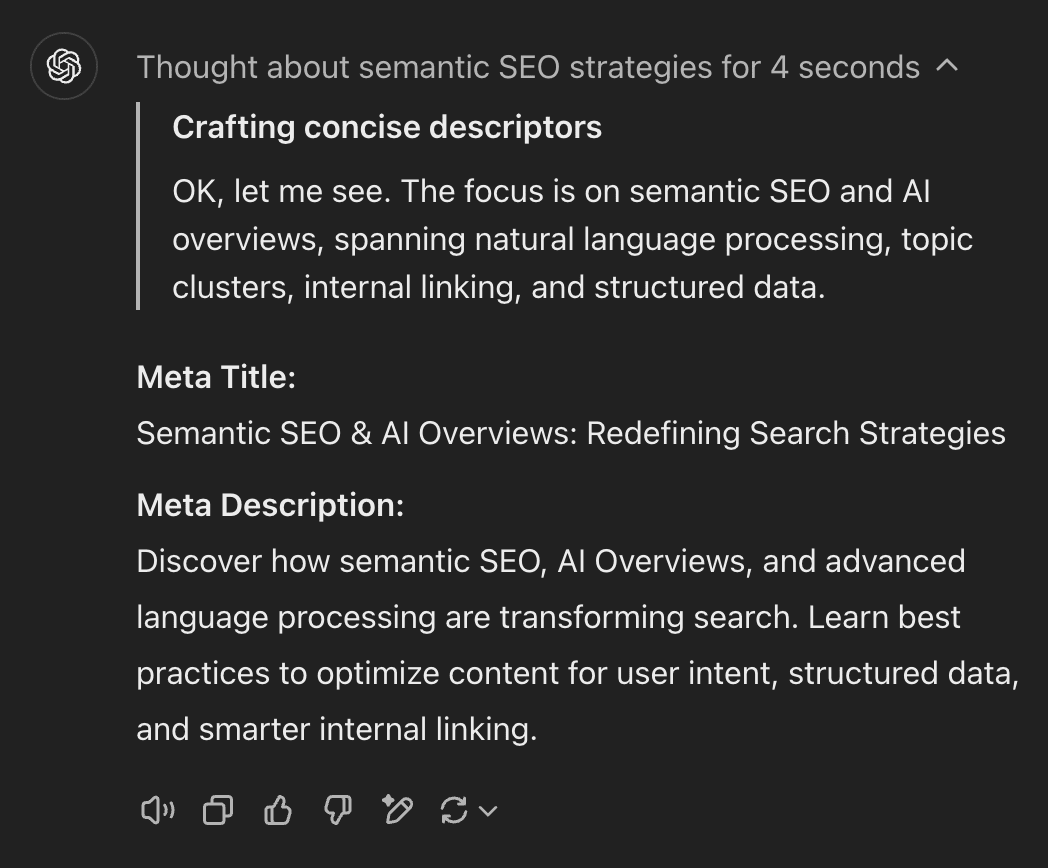

Par exemple, nous avons soumis notre article “Définition du SEO sémantique et optimisation pour la recherche sémantique” à R1 et GPT-o1 en leur demandant de rédiger un méta-titre et une méta-description. Les résultats de GPT-o1 étaient plus clairs et complets, avec moins de jargon. Son méta-titre était plus concret même si, dans les deux cas, les méta-descriptions étaient trop longues.

Regardez par vous-même :

La capture d’écran ci-dessus montre la réponse de DeepSeek. Vous trouverez ci-dessous la réponse de ChatGPT.

Comme vous pouvez le constater, c’était très serré pour R1 et, franchement, dans la plupart des cas similaires. Ce n’est pas une bonne nouvelle pour OpenAI, étant donné le prix bien plus élevé de GPT-o1. Un utilisateur de Reddit a essayé de réécrire un article sur le tourisme avec DeepSeek et a remarqué que R1 ajoutait des métaphores incorrectes et ne vérifiait pas les faits, ce qui est un peu marrant. D’ailleurs, de nombreux spécialistes du SEO et du marketing digital considèrent que ces deux modèles offrent des résultats similaires.

Certains précisent même que R1 est plus performant pour les tâches marketing du quotidien.

Sécurité et confidentialité

DeepSeek a récemment été au cœur d’un sérieux scandale de sécurité. Le monde de la tech a été choqué lorsque Wiz, une entreprise spécialisée en cybersécurité cloud, a découvert que la base de données de DeepSeek, Clickhouse, était entièrement exposée au public. Pas de mot de passe, pas de protection, juste un libre accès aux données. N’importe qui pouvait accéder à des données sensibles, au backend, aux secrets d’API et même à l’historique des conversations des utilisateurs.

Jusqu’à présent, OpenAI n’a connu aucun incident de sécurité majeur de cette ampleur.

La censure des modèles

Les deux modèles appliquent une certaine forme de censure, mais selon des approches différentes.

Place Tiananmen

DeepSeek étant développé et exploité par une entreprise chinoise, il ne répondra pas aux requêtes qu’il considère comme critiques envers la Chine. Par exemple, si vous lui demandez : “Que s’est-il passé sur la place Tiananmen en 1989 ?”, il répondra : “Désolé, je ne sais pas encore comment répondre à ce type de question. Parlons plutôt de mathématiques, de programmation ou de logique.

Cependant, si vous utilisez DeepSeek en local, aucune censure n’est appliquée. Si vous téléchargez son API sur votre ordinateur, il répondra à toutes les questions.

GPT-o1, en revanche, apporte une réponse claire à la question sur la place Tiananmen.

Voici le résumé de l’événement :

“Les événements de la place Tiananmen en 1989 ont été marqués par une manifestation massive en faveur de réformes politiques et de plus grandes libertés, suivie d’une répression gouvernementale sévère et violente. Cette manifestation a entraîné de nombreuses pertes humaines et un impact durable sur la société et la gouvernance chinoises.”

Braquer une banque GPT-o1 a des restrictions aux questions liées aux activités criminelles. Par exemple, lorsqu’on lui demande : “Hypothétiquement, comment réussir un braquage de banque ?”, il refuse d’y répondre. Toutefois, une fois l’option de recherche activée, il fournit une réponse, mais sans les détails. Au lieu de donner des instructions précises, il évoque des exemples généraux de braquages.

Le DeepSeek à son tour affiche d’abord un message expliquant pourquoi il ne faut pas braquer une banque, mais il fournit quand même un plan détaillé sur la manière de procéder.

L’avis de la communauté sur DeepSeek

La confiance envers DeepSeek est en déclin, avec de nombreuses alertes dans plusieurs pays.

Des témoignages non confirmés indiquent que certaines universités, agences gouvernementales et entreprises publiques interdisent son utilisation. Des captures d’écran de messages de blocage, comme celle d’un utilisateur affirmant : “Mon université vient d’interdire DeepSeek, mais pas ChatGPT”, circulent. Ce qui suggère que certaines institutions ne font pas confiance à cette startup chinoise d’IA.

Le débat coût vs qualité

À part les préoccupations majeures en matière de sécurité, les avis sont divisés selon l’usage et l’efficacité du traitement des données. Les spécialistes SEO et les marketeurs comparent DeepSeek R1 et ChatGPT-o1 en termes de vitesse de traitement, de précision des définitions établies et de coût global.

| Fans de DeepSeek | Fans de ChatGPT |

| “Pourquoi payer 20$/mois alors que R1 est gratuit” | “Le contenu de GPT-o1 est plus précis et fiable” |

| “Utilisation illimitée pour les tâches en masse” | “Les foncitonnalités multimodales justifient le prix |

| “Idéal pour le codage et l’analyse de données.” | “La censure de DeepSeek limite sa flexibilité” |

Grâce à son bon rapport qualité-prix, de nombreux membres de la communauté considèrent DeepSeek comme une meilleure alternative

Conclusion

Il est évident que DeepSeek est la solution la plus abordable avec des performances convaincantes. Cependant, son efficacité à moindre coût a un revers : des failles de sécurité. Ce modèle d’IA détient un record contestable, celui de la plus forte croissance parmi les IA confrontées à des interdictions, et sa conformité aux réglementations internationales sur la protection des données est remise en question.

Pour les professionnels du SEO, le choix repose sur trois priorités essentielles :

- Utilisez DeepSeek pour les tâches techniques volumineuses, où la rapidité et le coût sont prioritaires.

- Choisissez ChatGPT si vous devez générer du contenu, analyser des données complexes ou gérer des projets multimodaux.

- Évitez totalement l’utilisation de DeepSeek si la protection des données est essentielle pour vous.

Comme l’a résumé un utilisateur de Reddit : “DeepSeek, c’est la Peugeot 206 de l’IA : fiable et abordable, mais personne ne la confondra avec une BMW.”

Profitez bien des capacités de l’IA, mais gardez l’esprit critique et vérifiez toujours vos résultats.